最終更新:

![]() kenken2020 2024年01月03日(水) 19:16:12履歴

kenken2020 2024年01月03日(水) 19:16:12履歴

Anything-V3.0 DL先:StableRes.info

- StableRes

- あらゆるStableDiffusionのfine-tuningモデル、ツール、Textual inverisonのptファイル、Hypernetwork、Aesthetic Gradientsをまとめたサイト

- Stable Diffusion

- 入力した文字列から高精度な画像を生成できるAI

- 2022年8月にオープンソースとして公開された

- 基本的に出力した画像は商用・非商用を問わず、自由に利用できる

- Waifu-Diffusion

- Stable Diffusionの派生

- Stable Diffusion web UI(AUTOMATIC1111版)

- 現状(2022/10/中旬)ではこれがベスト

- NMKD Stable Diffusion GUI

- NovelAI

- 何だかんだで一日の長がありクオリティが一歩抜きん出ている

- Artroom Stable Diffusion

- Photoshopで動かすプラグイン「alpaca」

- クリスタで動かすプラグイン

- Google Colabを使った方法

- Midjourney

- その他のサービス

- Ver1.4

- 顔面修復のアルゴリズム?

- Waifu Diffusion v1.2

- Release Date: 07/09/2022

- Waifu Diffusion v1.3

- 「Float 32 Full Weights」をダウンロード

- 近いうちにVer1.4が来る?

- Hentai DiffusionはWaifu-Diffusion v1.2のフォークモデルで、二次元画像サイトのRule34とGelbooruにアップされている15万枚の画像でトレーニングされています。

- GitHubの方がBANされて今は「Hugging Face(主に自然言語処理を対象にした大規模なオープンソースコミュニティー)」で公開されている

- 「RD1212.ckpt」をダウンロード

- e621

- 海外ケモナー向け画像投稿サイト

- rule34

- 4ch系海外画像投稿サイト

- Danbooru

- 海外画像投稿サイト

- メタタグが優秀?

- Gelbooru

- Danbooruの姉妹サイト?

- AND検索

- blonde_hair blue_eyes

- ブロンドの髪と青い目の両方を持つ投稿を検索します。

- OR検索

- blonde_hair or blue_eyes

- ブロンドの髪または青い目の投稿を検索します。

- NOT検索

- 「-blonde_hair -blue_e」

- ブロンドの髪でも青い目でもない投稿を検索します。

- fav:albert

- ユーザー albert がお気に入りにした投稿を検索します。

- fav:albert

- ユーザー albert がお気に入りに追加していない投稿を検索します。

- ordfav:albert

- ユーザー albert がお気に入りにした投稿を、アップロードされた日付ではなく、お気に入りに追加された順序で検索します。

- favcount:>10

- お気に入りが 10 件以上ある投稿を検索します。

- order:favcount

- 検索結果をお気に入りの多い順に並べます。

- age:2weeks..1year or age:2w..1y

- 2 週間から 1 年前にアップロードされた投稿を検索します。利用可能なパラメータ: 秒 (s)、分 (mi)、時間 (h)、日 (d)、週 (w)、月 (mo)、年 (y)。パラメーターが明確である限り、パラメーターの任意の省略形が可能です:

- score:100

- スコアが 100 の投稿を検索します (id 検索と同じ構文を使用します)。

- order:score

- 投稿スコアの降順で検索結果を並べ替えます。

- order:rank

- スコアとアップロードの最新性に基づいて降順で検索結果を並べ替えます。

- order:upvotes

- 順序付けの検索結果は、賛成票の数に基づいて降順になります。

ファイルの種類

- filetype:png

- ファイルタイプが PNG の投稿を検索します。一般的なファイル形式: jpg、png、gif、swf、webm、mp4、zip ( ugoira )。

参考:【ノイズ除去+拡大】AIで作った小さな画像を綺麗に拡大する方法【RealESRGAN】

参考:画像を高画質化する AI の Real-ESRGAN、ウルトラスーパーガチで凄すぎて超絶ビビってるwaifu2x-caffe と違って

Real-ESRGANのGitHub

拡大後

参考:画像を高画質化する AI の Real-ESRGAN、ウルトラスーパーガチで凄すぎて超絶ビビってるwaifu2x-caffe と違って

Real-ESRGANのGitHub

- 「Real-ESRGAN」というアルゴリズム?ライブラリが優秀て、画像を拡大しノイズを除去してくれる

- SD Web UIの機能に「SD Upscale」があるが、専用のオンラインサイトを使った方が早くて綺麗

- ここで「Practical Image Restoration Algorithms for General/Anime Images」で

- 対象の画像をドロップする

- Versionはアニメ系のイラストの場合「Anime – anime6B」を選ぶ

- scaleで拡大サイズを選ぶ

- Submitを押して待つ

拡大後

[Errno 2] No such file or directory:

Tile size. Default is 0, that is no tile. When encountering the out-of-GPU-memory issue, please specify it, e.g., 400 or 200

タイルの大きさ。デフォルトは0、つまりタイルなし。GPU メモリ不足の問題が発生した場合は、400 や 200 などと指定してください。

Tile size. Default is 0, that is no tile. When encountering the out-of-GPU-memory issue, please specify it, e.g., 400 or 200

タイルの大きさ。デフォルトは0、つまりタイルなし。GPU メモリ不足の問題が発生した場合は、400 や 200 などと指定してください。

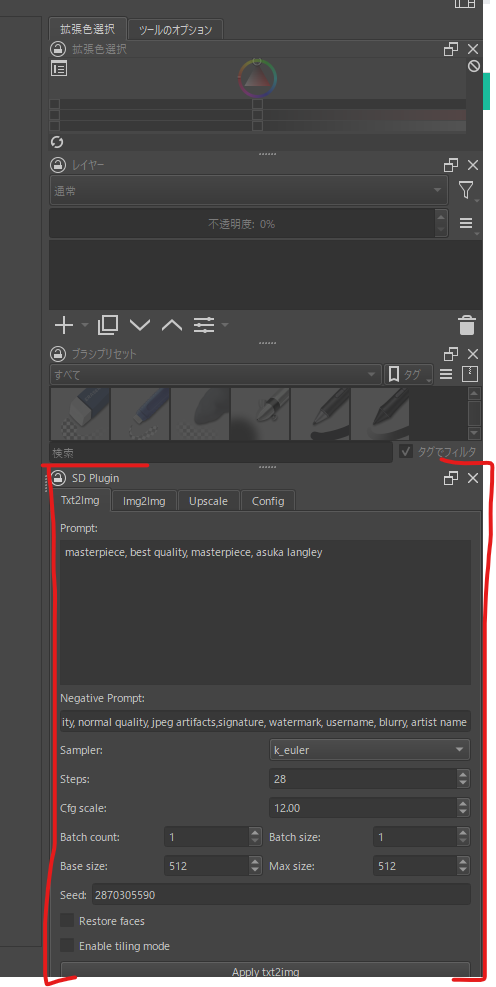

GitHub:Stable Diffusion Krita Plugin

参考:Stable Diffusion メモ(4) 絵の描けない人が Krita Plugin で選択範囲にimg2imgかける

参考:Stable Diffusion メモ(4) 絵の描けない人が Krita Plugin で選択範囲にimg2imgかける

- Krita用に同じ環境を作る感じか?

- Krita 5.1.0 をインストールする

- インストール言語Englishでインストールしても自動で日本語化されている

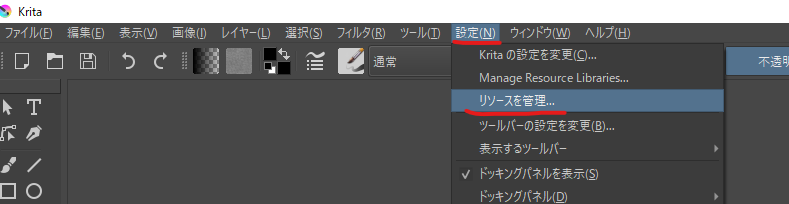

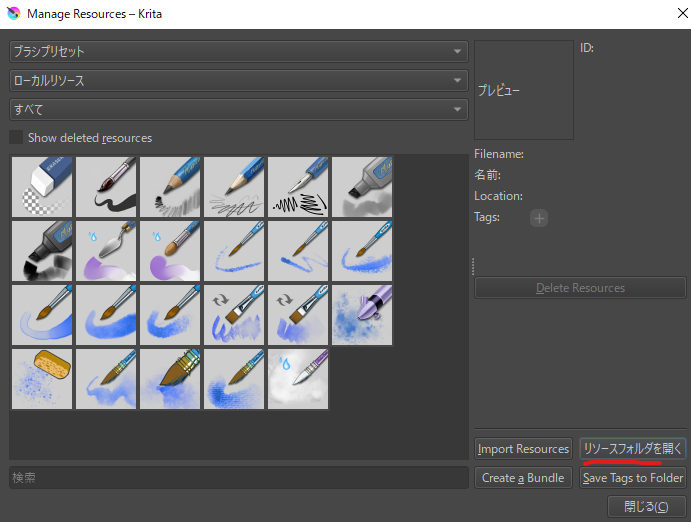

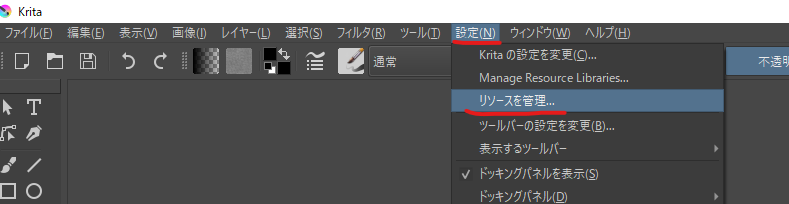

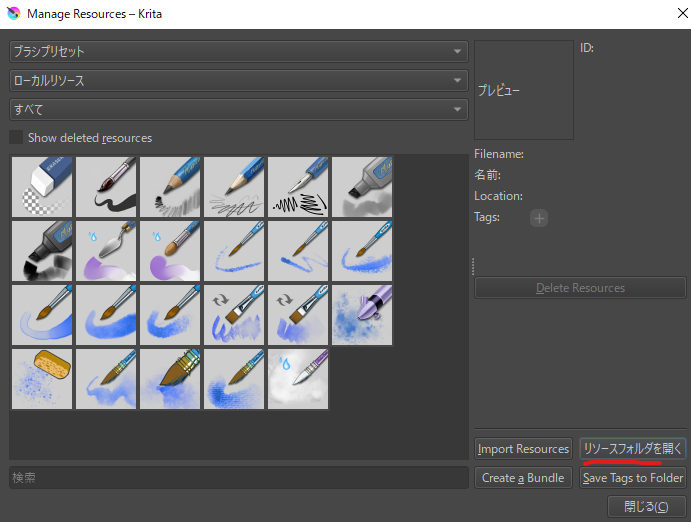

- Kritaを起動して、メニューから「設定」 - 「リソースを管理」 を選択し、画面の「リソースフォルダを開く」を押す

- 取ってきたKrita Pluginのコード一式から krita/plugin 下の krita_diff フォルダとkrita_diff.desktop ファイルをpykrita フォルダに置く

- Kritaを再起動する

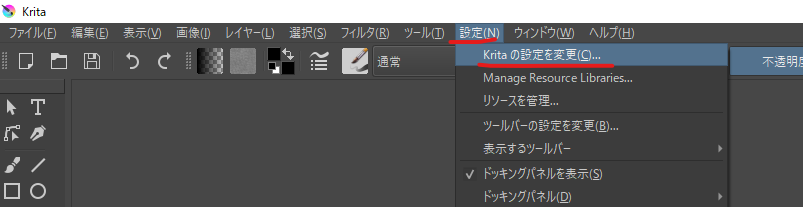

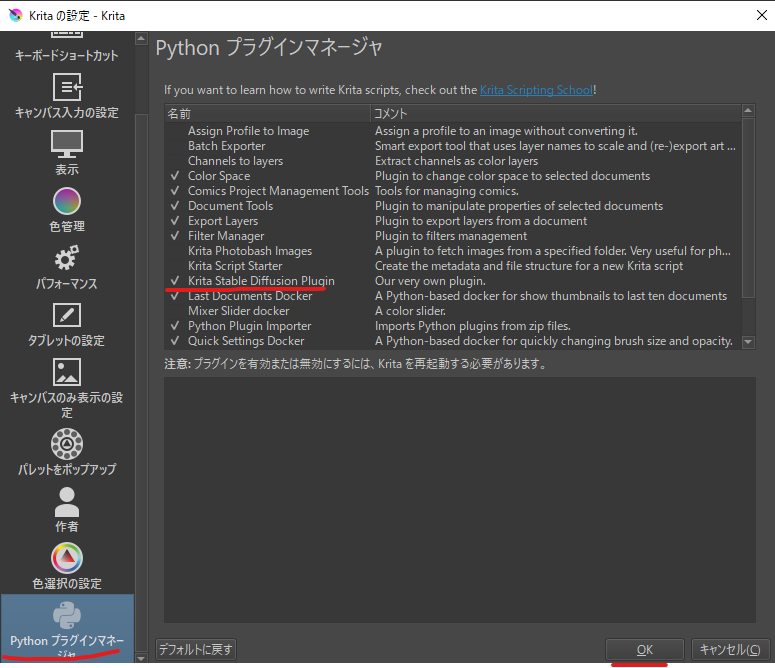

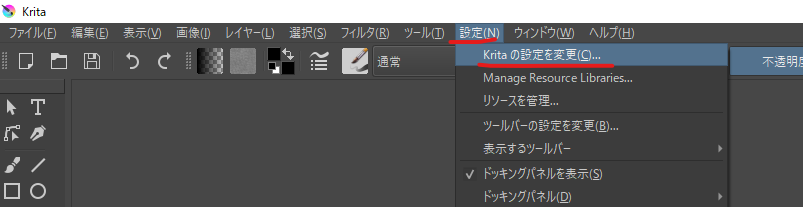

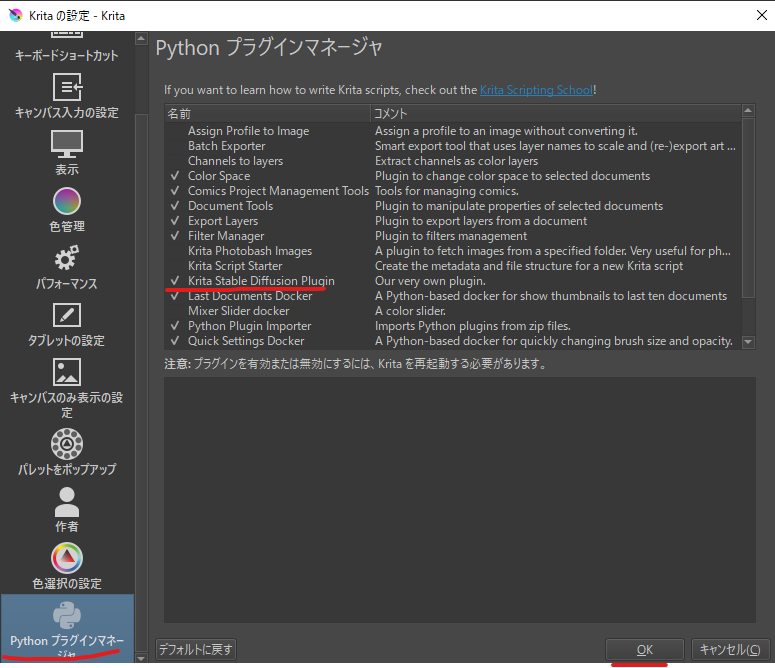

- メニューから「設定」 - 「Kritaの設定を変更」 を選択し、画面の「Python プラグインマネージャー」を選択して「Krita Stable Diffusion Plugin」の左にあるチェックボックスのチェックを入れる。

- 「OK」ボタンを押し、Kritaを再起動する。

- フォルダ「stable-diffusion-krita-plugin」の中にWebUI版と同じように「hypernetworks」「Stable-diffusion」「GFPGANv1.4.pth」をコピーする

- バッチ「webui-user.bat」を叩けばなんか良い感じにインストールと起動をしてくれる

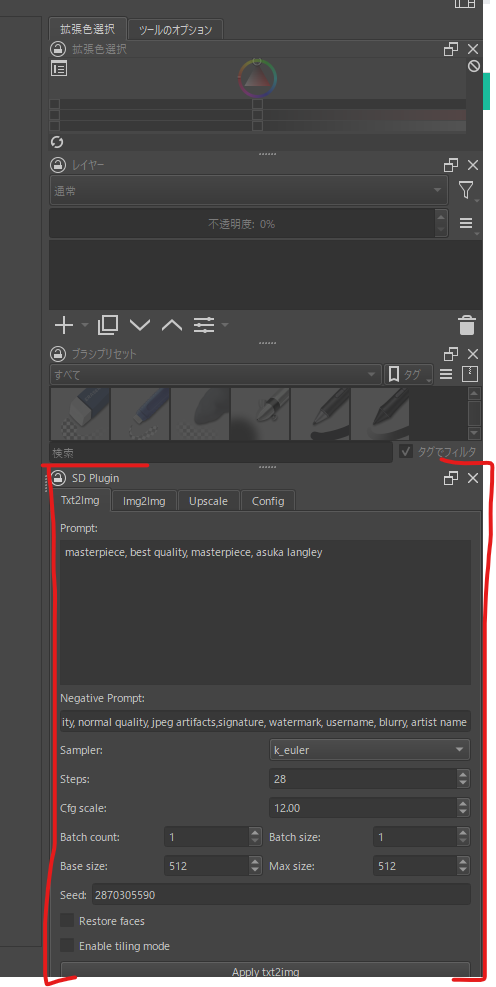

- Kritaを起動し、プラグインが正常にインストールされていれば、下のようなパネルが表示される

- 大抵の設定の優先度は SD Pluginドッキングパネルの設定 > yamlの設定

- 2022/10月中旬現在「AUTOMATIC1111版Stable Diffusion web UI」がベスト?

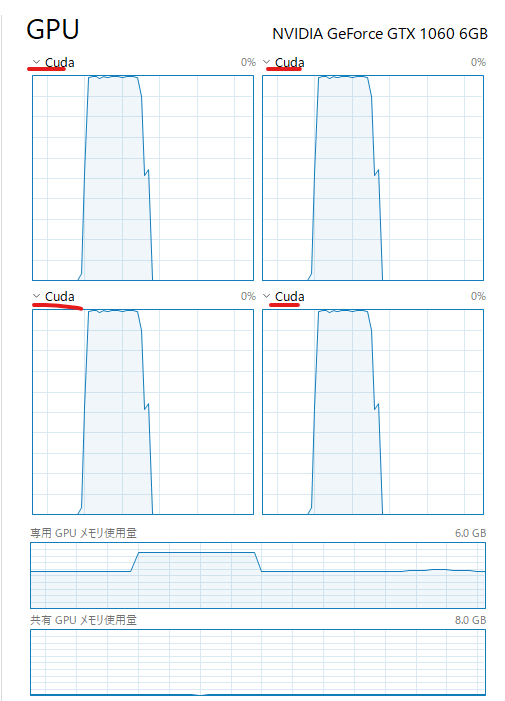

- VRAM10G以上推奨だが、6Gしかない

- 解像度は512×512がベター(全身イラストなら512*768)

- そもそもモデルが512×512に最適化されている

- 画像面積はそのままVRAMの使用量に反映されるので、縦長画像などはエラーに注意

- ラフ画風→「sketch, one-hour drawing challenge」ワンドロ

プロンプトで出力を詳細に制御するのは不可能だ。

img2img を使って画像を加工する方がはるかに早い。

ネガティブプロンプトはとても強力

『描いてほしくないもの』を指定することで効率的な絞り込みができる

一番最初にキャラクターの要素を全部無視して、構図だけを引き当て、その後からキャラクターの要素をpromptで調整して画像に反映させる

{{cinematic lighting}},{{chromatic aberration}},lens flare,beautiful detailed glow,light_leaks

{{映画的照明}}, {{色収差}}, レンズフレア, 美しい輝き, 光漏れ,

lens flare レンズフレア

{{映画的照明}}, {{色収差}}, レンズフレア, 美しい輝き, 光漏れ,

lens flare レンズフレア

- まずはどんな壁尻の構図が欲しいか決める

- A:tetxt2imgガチャで欲しいのが出るまで粘る

- B:ペイントざっくりしたラフを描く

- 次のプロンプト、サンプリングステップ「9」、サンプリング方法「DDIM」、CFGスケール「7」、バッチ数やバッチサイズを増やしガンガン回す

- 必要最低限の呪文、化け物率が多いので、ガチャは多めに回す必要がある

- ここではキャラクター要素は入れない

- 冒頭の「nsfw」でエロ解禁、次の「solo , 1girl」で人数指定、「buttock wall, bend over backwards」は壁尻を表す

- ステップ1で出来た構図を元に「img2img」で仕上げていく

- ステップ1で使った次にプロンプトに「nsfw , solo , buttock wall, bend over backwards」

- 追加したプロンプトはキャラクター(今回の場合、艦これの島風)とキャラクターの下半身要素を追加している

- サンプリングステップ「30」、サンプリング方法「オイラーa」、CFGスケール「7」、ノイズ除去強度「0.75」

- ネガティブプロンプトで上半身を排除した方がいい?

- 「upper body」では余計化け物が増える

- 壁尻を表すプロンプト

through wall , glory wall , stuck

- 下半身を表すプロンプト

- 関連プロンプト

brick wall

photo (object)

- 写真は別で作りフォトバッシュした方が良いかも?

- よく使うシチュエーション

- blush , lying on bed

- セックス基礎呪文

- nsfw,{{sex}}, cum in pussy

- 「1boy, penis,」が無いと事後っぽいのが多い?

- nsfw,{{sex}}, cum in pussy

topless トップレス

no panties ノーパン

back 背中 魅惑の背中 ぱっくり背中 せなか

bare shoulders むき出しの肩

bed sheet ベッドシーツ

- ベッドシーツのみが表示されている場合、通常はキャラクターの背後にある抽象的な背景として。ベッドの残りの部分(ヘッドボード、フレームなど)は見えないようにします。このタグはbedでは使用できません。

◎体勢

arched back 仰け反り絶頂

bent over 前屈、脚(少なくとも太もも)を垂直にし、胴体を水平に曲げ、お尻を突き出した状態。お尻を広げて、表面(机、テーブルなど)に横たわっている状態、またはトップダウン・ボトムアップの性的状況。

◎オプション

breast grab 乳房掴み、他人の胸を掴む。自分の胸をつかむ場合は( grabbing own breast )

grabbing from behind 背後から胸揉み 背後から乳揉み

参考:画像生成AI「Stable Diffusion」でプロンプト・呪文やパラメーターを変えるとどういう差が出るか一目でわかる「Prompt matrix」と「X/Y plot」を「Stable Diffusion web UI(AUTOMATIC1111版)」で使う方法まとめ

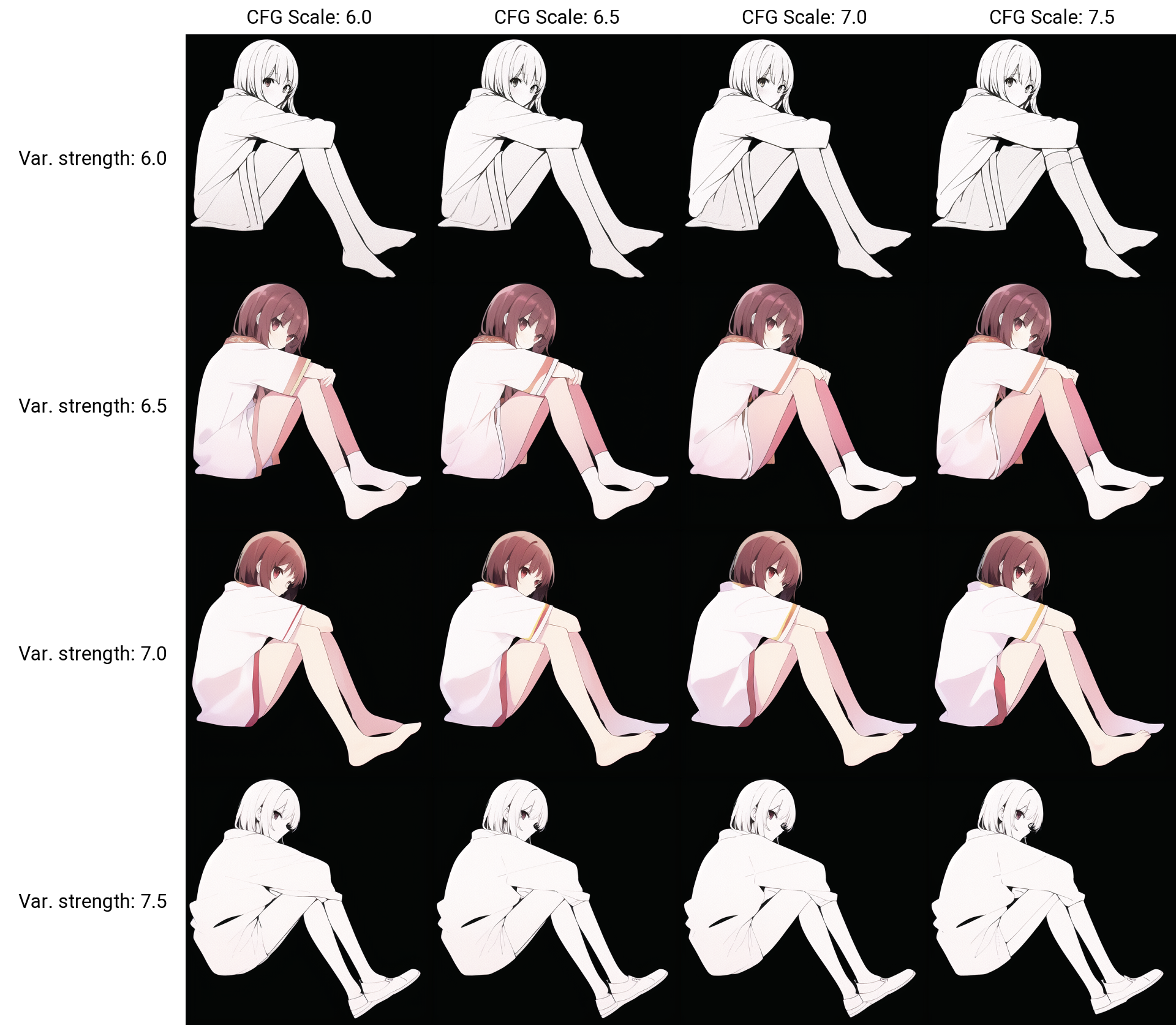

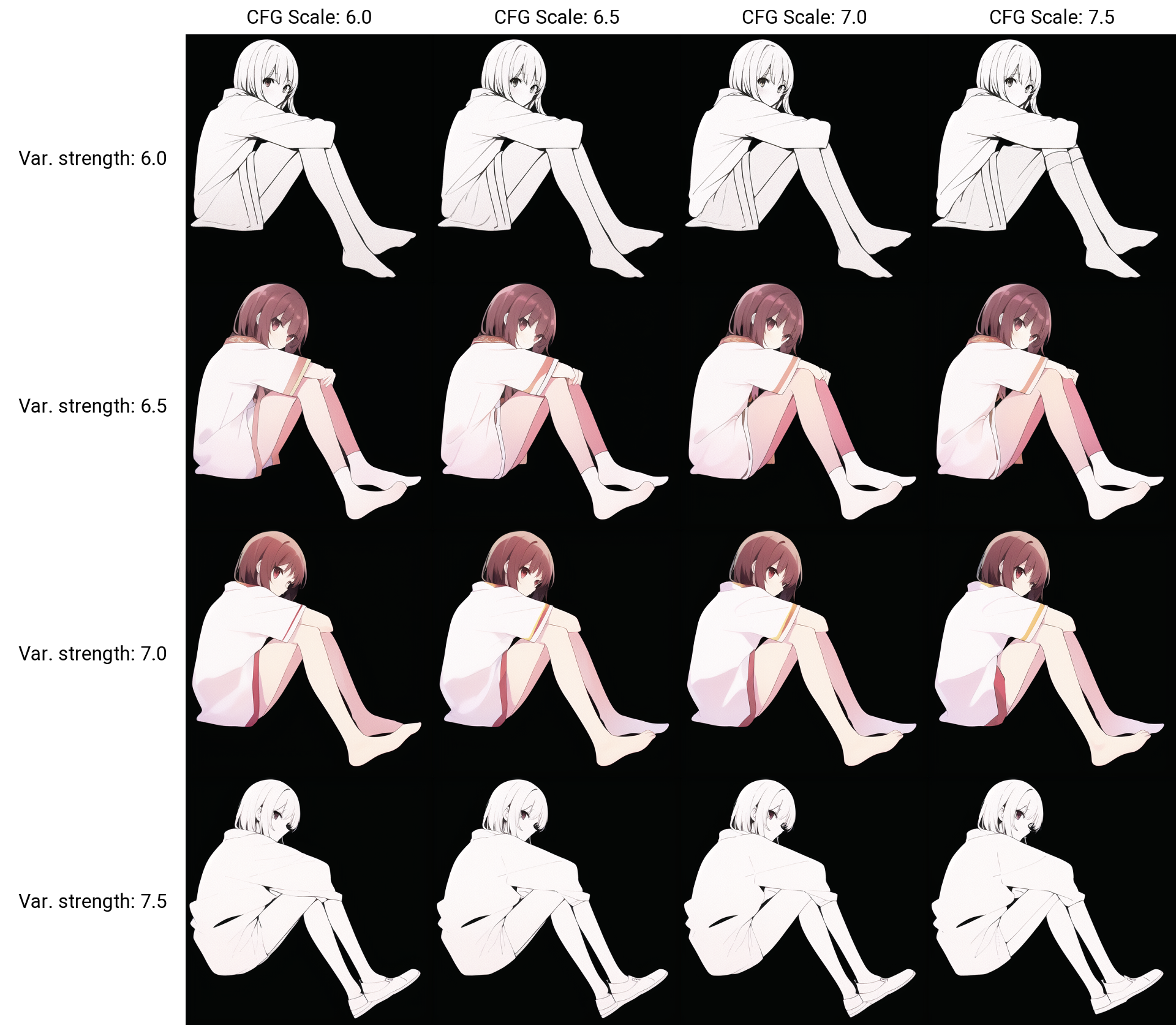

「CFG Scales」を(6.0〜7.5)の値と「ノイズ」(6.0〜7.5)のマトリックス

「CFG Scales」を(6.0〜7.5)の値と「ノイズ」(6.0〜7.5)のマトリックス

参考:プロンプト(prompt)の入力

- カンマ「,」で区切って、盛り込みたい要素を箇条書きで並べていく

- 前に書いた呪文の方が優先されやすい

- 排除されてしまうタグは{{{}}}で強調し、できるだけ前に持ってくることで、AIに無視されにくくなる

- 順序が混ざると結果も混ざる

- 複数キャラへの指示が入れ違いに配置されているとAIも混乱しやすい

- きっちりとキャラごとに指示をグループ化すること

- 男性への指示が女性の文章の後ろに来ないようにすると呪文が混ざりにくい

- ex)「黒髪で黒い肌の太った中年の男」と「金髪で白い肌の巨乳の女」

- ex)「1boy is black hair dark skinned fat middle aged man」「1girl is gold hair white skin」

- DeepL翻訳である程度描画したい人物の風貌を文書にした方がいい?

- 代名詞を使う事で行動の主従が逆転してしまう現象を防ぐ

- 「AがBに○○している」と指示したいのに、「BがAに○○している」絵が生成されてしまうケース

- キスする人が男女逆になってしまうなら、「kissing cheek」を「kissing his cheek」とすることで、「女性が男性にキスするんだよ」という指示が伝わりやすくなる

強調したいプロンプトは{}でくくる(NovelAIの記法)- 強調したいプロンプトは()でくくる(SD(Stable Diffusion)の記法)

- ()で囲むと1.1倍強く出す

- *1と重ねて囲むと乗算で強調(2重なら1.1x1.1の1.21倍)

- 弱めたいプロンプトは[]でくくる(NovelAI、SD共通)

- 画像生成の途中でプロンプトを変更する機能

- たとえば "a girl [wearing a onepiece:naked:0.5]" とすると、服が透けている表現になる。

- これはステップ数が 50 とすると、最初の 1〜25 ステップは "a girl wearing a onepiece" を実行し、26〜50 ステップは "a girl naked" を実行する。

- [ward:1]の指定はタイミングを指定したprompt条件指定に使える。

[条件前呪文:条件後呪文:条件数値]

- 条件数値:step数かsteps割合を指定する。

- 整数指定(8とか20とか)はその値が条件step回数になる

- 小数指定(0.3とか0.5とか)は指定steps * 指定数値が条件step回数になる

- 条件前呪文:stepが条件step回数になるまでprompt文として影響を与える(省略可能)

- 条件後呪文:stepが条件step回数になった後からprompt文として影響を与える(空欄可能)

- この呪文内にも()や[]を使っても問題ない。条件を入れ子にしても機能する

- 要素の影響のコントロール「構図に影響を与えたくないけど、影響力の強い要素を付け加えたい」という場合に威力を発揮する

- 特にseed値固定で呪文をいじる時に重宝し、構図の定まるstepを狙い[XXX:0.5]などとすれば、構図への影響を最小限にXXXの要素を加えることが狙える

- ダメな時もある。ステップ数はある程度無いと要素を書き換えきれない

- seed値固定以外でも涙(tears)のような表情に大きく影響する要素を[teras,:0.6]のように遅らせると「ちょっと涙目」が狙える

- あるいは[ポーズに影響を与える背景:映したい背景:2]ならポーズの傾向を指定しながら背景を指定することが狙える。例えばin bed:in beachとか

- ネガティブへ導入:例えば「上半身が正面を向いているのに下半身が尻を向けている構図」に出会うことがある

- しかしhipなどをそのままネガティブに入れると下半身の描画自体が減ってしまいやすいなど若干影響がある

- そこで[hip:5]のように入れることで下半身が出る構図を容認しつつ尻が出ていたら途中から軌道修正を狙える

- [smile:sad:0.5] として表情をブレンドすることも可能。

- "[white::0.5] hair, [:red:0.5] eye" などで色移り対策

- [octane render::0.5] で実写とイラストをブレンド

- [cloth:naked:0.5] で透けを表現できる

- [no wearing:wearing blue dungarees:0.1] で裸オーバーオール

- 「1 girl」などと人数指定をはっきり指示しておくこと!

- 人数をしていしないと、意図しなく人数が増えてしまう事がある

- イラストの主体が女性でも、男性の局部が写り込んでいるエロ画像の場合は「1girl, 1boy, solo focus」と、「男性が1人いる」ことも記入してあげた方がAIは理解しやすい

worst quality,low quality,normal quality,lowres,bad anatomy,ugly, fewer digits,missing fingers,extra digit,bad hands,text,error,futa,futanari,shemale, watermark,signature,username,artist name, missing limb, floating limbs, disconnected limbs, out of frame, trademark, mutated hands and fingers, poorly drawn hands, malformed hands, poorly drawn face, poorly drawn floating cock, censored, bar censor

参考:Waifu Diffusion で効率的に画像を生成する

サンプル)「Sampling Steps 50」、作業時間は4枚で約2分

- DDIM サンプラーで inference step 8くらいで画像を量産して、その中から良さそうなものを inference step 50 で再生成するか、加筆修正して img2img に入力する

- Sampling Stepsのこと?

- 解像度を変更すると作成される画像の構図や色が変更される

- サンプラーの Euler a や DPM2 a はステップ数が変わると絵も変わるので、この方法は使えない

- DDIM は速い。計算が速さと完成像が予測できるようになるまでのステップ数のバランスが良い。なのでシードガチャに向いている。

- プロンプトがシンプルなら8ステップで良い結果が得られる。複雑なプロンプトの場合は 25 以上のステップが必要になる。

サンプル)「Sampling Steps 50」、作業時間は4枚で約2分

参考:イラストAI「Stable Diffusion」でキャラを作り表情バリエーションも作る

- 良い感じの正面顔が出るまでガチャ+フォトバッシュ

- talking-head-anime-3-demoで表情を作る

- 顔の部分は128x128px

- スライダーを何やかんやして良い感じを表情を撮っていく

参考:Novel AIによるイラスト大量生産時代に絵描きが生き残るには

- ↓の様なキレイな三面図を出力するのは難しい

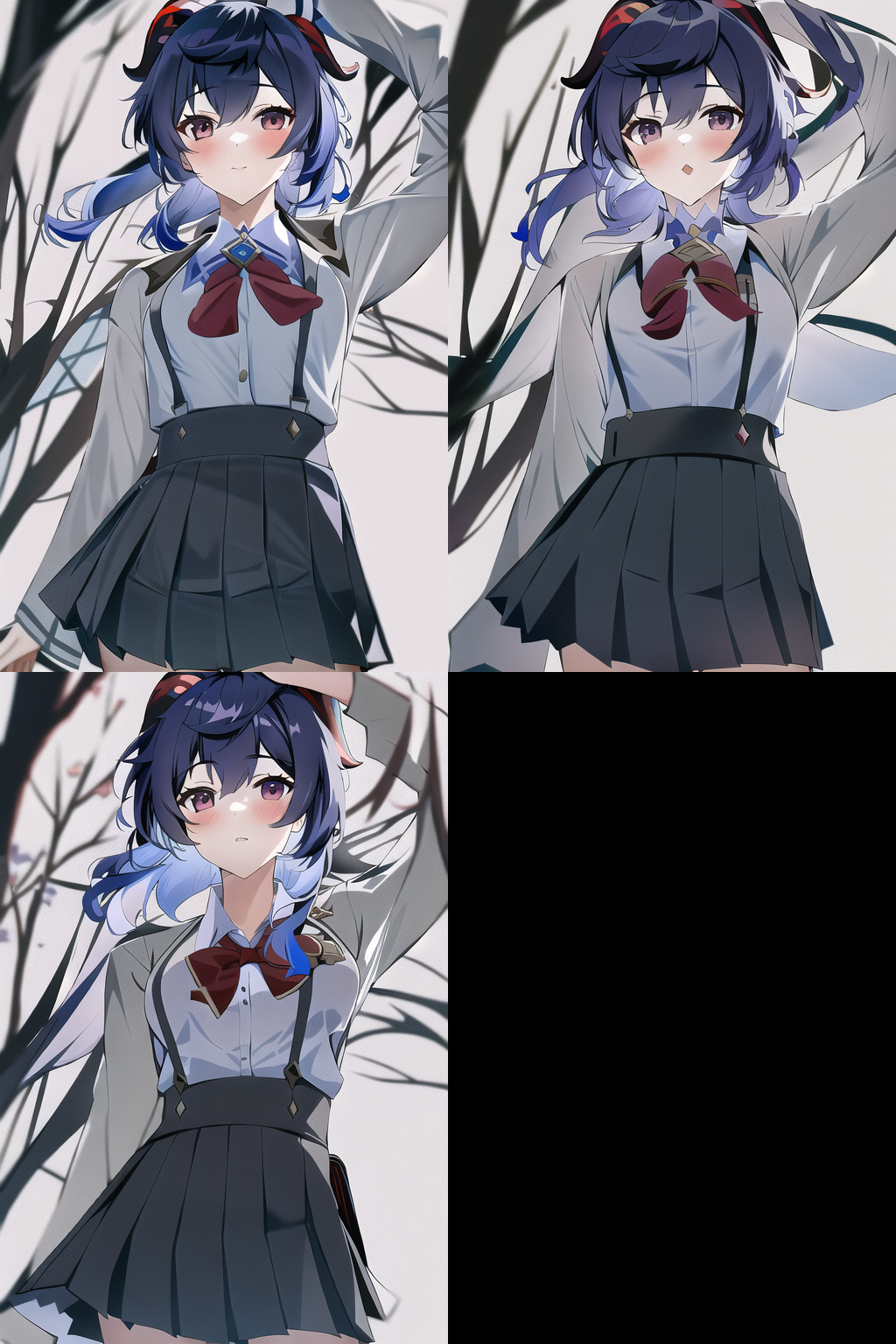

- 次のプロンプトで出力「ganyu_\(genshin_impact\),{{masterpiece}},{{three-sided view}}, reference sheet, school uniform, {{white background}},」

reference sheet キャラ設定

three views from front, back and side キャラクター三面図

costume setup materials 設定画風

{{white background}} 白背景

{{three-sided view}} 三面図は強調した方がいい

{{masterpiece}} 高画質のおまじない

three views from front, back and side キャラクター三面図

costume setup materials 設定画風

{{white background}} 白背景

{{three-sided view}} 三面図は強調した方がいい

{{masterpiece}} 高画質のおまじない

- バッチファイル「webui-user.bat」を開く

- バッチファイル内の項目「set COMMANDLINE_ARGS=」に「--deepdanbooru」を加える

set COMMANDLINE_ARGS=--deepdanbooru

コメントをかく