最終更新:ID:a18CyCxtew 2023年01月14日(土) 20:56:50履歴

DreamBoothと同様に、学習内容をモデルデータに埋め込む

設定が簡単で高性能、あと処理速度がわりと速いのが特徴

公式 https://github.com/devilismyfriend/StableTuner

設定が簡単で高性能、あと処理速度がわりと速いのが特徴

公式 https://github.com/devilismyfriend/StableTuner

- https://github.com/aka7774/elemental_code/blob/mai...

- インストールしたいフォルダで実行する(中に自動的にStableTunerフォルダを作る)

- うまくいかんかったら何回か実行するとそのうちうまくいくかも

- 起動はstart.batから

- pythonとgitにPATH通ってない人は要編集

ここではminicondaを例に説明

Conda 公式サイトの Miniconda のページからインストーラーをダウンロード

https://docs.conda.io/en/latest/miniconda.html より

Windows Miniconda3 Windows 64-bit をダウンロードし、インストール

Conda 公式サイトの Miniconda のページからインストーラーをダウンロード

https://docs.conda.io/en/latest/miniconda.html より

Windows Miniconda3 Windows 64-bit をダウンロードし、インストール

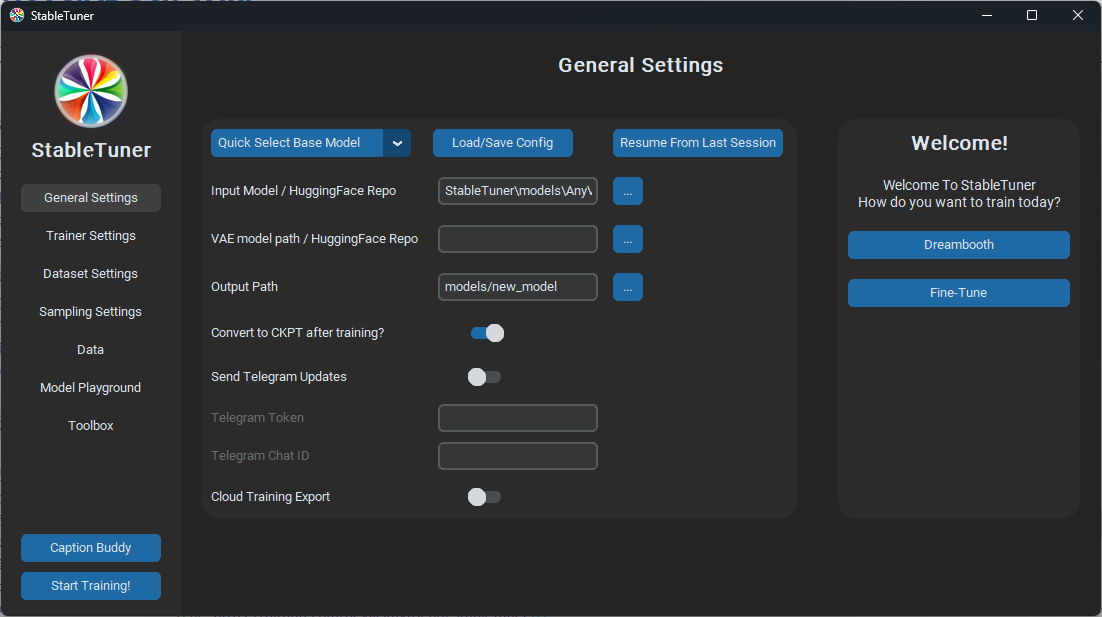

| Input Model / HuggingFace Repo | 学習元となるモデルファイルのpathを入力 ファイル選択時にSD2形式か問われるので「はい」か「いいえ」を選択 |

| VAE model path / HuggingFace Repo | 空欄でも良い |

| Output Path | 作成したモデルの出力path |

| Comvert to CKPT after training | トレーニング後にモデルをckptに変換する |

| Cloud Training Export | ONにすると下の Start Training! ボタンが Export for Cloud! に変わる クラウドで学習してる場合に使用出来る?(未確認) |

| Train Batch Size | 大きくすると一度に学習する枚数が増えるが、必要以上に大きくすると物凄く処理に時間が掛かる RTX 3090 ならデフォルトの24で動くが多少下げた方がいいかも VRAMが少ない場合は1や2まで下げる事 |

| Train Epochs | 学習回数を何セット廻すか 基本はデフォルトの100で良い 学習データにも寄るが300も廻すと過学習になる |

| Train Text Encoder | OFFにすると精度は下がるが処理速度があがる |

| Save and sample Every N Epochs | 学習結果のデータを何Epoch毎に出力するか Train Epochsを増やしてる場合などは、適度に調整 |

学習元データの設定

Add Conceptボタンから作成し、クリックで設定

設定したらsaveで保存する

Add Conceptボタンから作成し、クリックで設定

| Dataset Token/Name | 学習セットの名前 |

| Data Path | 学習用画像のあるディレクトリを指定する |

| Class Name | 正則化Classの名前 |

| Class Path | 正則化画像のあるディレクトリを指定する |

タグ

このページへのコメント

custom-conda-path.txtではなく

custom_conda_path.txtっぽい?(ハイフンでなくアンダーバー)

3070 8GB

では DBは無理だった・・・

1でもメモリ不足言われる・・・

2023/1/24のアップデートは不具合があったみたいで学習を実行すると必ずエラーになってましたが、

今日のアップデートにより同じ条件で学習の実行を行ってもエラーは発生しなくなってました。

この学習方法の場合、重要なのは

画像に紐付けたキャプションとファイルネームの扱い。

デフォルト設定だと、

どちらにも紐付けるような設定になってる。

特に学習元のキャプションは重要で、

これが無い状態で学習させると

全然「動かない」モデルになる。

また学習自体は、モデル全体に及んでるのがわかる。

例えば女性のキャラを覚えさせて、

その後、男性(man)のプロンプトを入力してみたら、

男性の方も同じ画風で描かれる。

またkatanaのプロンプトを入力したら

その女性キャラ風の和風少女が出てきた。

DBと違って出てくる絵の破綻率は少なく

扱いやすい学習方法だとは思った。

それと正則化画像は、透過画像で十分OK。

モデルから生成のも試したけど、

DB程、正則化画像にこだわる必要は無い。

>DB程、正則化画像にこだわる必要は無い。

こう書いたけどデフォルト設定じゃ無く、

「Dataset Settings」の「Add Class Image to Dataset」の

チェックをONにすると、正則化画像を使う様になる模様。

ただこの場合、時間がかかる。

学習52枚、正則化画像の350枚の設定で

4万ステップ以上になり、3060使用で、10時間くらいかかった。

そして、この場合あんまり溶け込まない。

結果、正則化画像に強く寄った絵が出てきた。

なので「Add Class Image to Dataset」チェックは

入れない方が良いと思われる。

Instance PromptとClass Promptの設定が見当たらないけど無い仕様かな

DataタブのDataset TokenとClass Nameにそれぞれ入れてみたけどt2iで特徴呼び出せないから違う模様